Le capitalisme à l’ère de l’IA : une « machine à valeur perpétuelle » ?

Gemini est-il neutre lorsqu’il s’agit de prendre position sur le place de l’IA dans le système économique ? Selon lui, l’IA révolutionne les modes de production et périme les analyses du Capital relatives à la valeur travail. Après avoir rappelé l’interprétation marxienne traditionnelle d’un transfert du travail humain via le capital, le chatbot en remet aussitôt en cause les fondements, d’une façon radicale, à la question « Que vaut ce raisonnement à l’ère de l’IA ? » :

2. La vision “critique” : L’IA fait quelque chose de nouveau

C’est là que le bât blesse. Cette vision soutient que l’IA (surtout l’IA générative) n’est pas un simple marteau ou un métier à tisser.

Elle effectue un travail cognitif : L’IA ne se contente pas d’exécuter une tâche physique. Elle analyse, rédige, raisonne, crée des images, optimise des stratégies. Elle accomplit des tâches qui étaient le monopole du travail humain “vivant” et intellectuel. Elle génère de la nouveauté : L’IA produit des solutions, des textes ou des images qui n’existaient pas auparavant. Cela ressemble étrangement à une création de valeur. Si l’on admet que l’IA crée de la valeur, cela pose un problème insoluble à la théorie de Marx :

➡️ Le paradoxe de la plus-value : Rappelez-vous : chez Marx, le profit (la plus-value) vient du fait qu’on paie l’ouvrier moins que la valeur qu’il crée (on paie sa force de travail pour 4h, mais on l’utilise 8h).

Mais… on ne paie pas de salaire à une IA. 🤖

Si une usine est 100% automatisée (dirigée par une IA, avec des robots), elle produit des marchandises. Mais s’il n’y a plus de “travail humain vivant” à exploiter, d’où vient le profit ?

Si l’IA (machine) ne crée pas de valeur, le profit devrait être nul (selon Marx). Or, l’entreprise fait des profits évidents.

Cela suggère que la valeur doit venir d’ailleurs que du seul travail humain vivant. En conclusion : Que sauver de Marx ?

À l’ère de l’IA, la théorie de la valeur-travail stricte (seul le travail humain crée de la valeur) est difficile à défendre.

Le bot de résumer, un peu plus loin :

Dans le modèle Marx, l’usine s’automatise, le capitaliste remplace les hommes par des machines (IA).

Ses coûts en salaires (capital variable) chutent.

Ses coûts en machines et énergie (capital constant) explosent.

La théorie de Marx prédit que, comme le profit ne vient que des salaires (variable), ce capitaliste devrait voir son taux de profit s’effondrer.

Or, nous voyons l’inverse : les entreprises de l’IA ont des profits astronomiques.

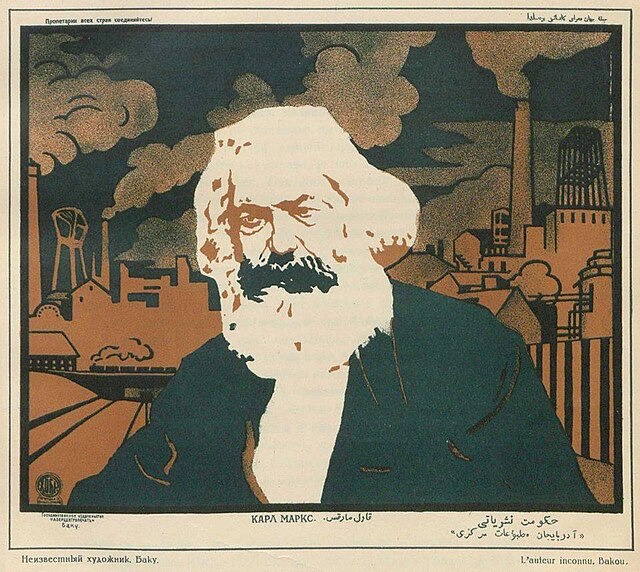

« Que sauver de Marx ? » demande Gemini, pour répondre : pas grand-chose. L’auteur du Capital est, en quelques lignes, rhabillé pour l’hiver. Selon Gemini, en effet, l’automatisation par l’IA transforme la composition du capital : les salaires (capital variable) s’effondrent tandis que les dépenses en machines et en énergie (capital constant) explosent. Or, alors que la théorie marxiste prévoit qu’une telle substitution devrait faire baisser le taux de profit (puisque seule la part salariale créerait de la plus-value), on constaterait, au contraire, des profits « astronomiques » dans l’IA. De là, Gemini infère que la logique de Marx ne s’applique plus : nous aurions changé de régime économique. La valeur pourrait désormais surgir quasi ex nihilo, à partir de systèmes automatisés à coût marginal très faible : un simple « prompt » tapé sur un clavier pourrait engendrer magiquement des mémoires juridiques, des logiciels, des romans, des plans marketing, etc. ; et ces résultats, sans commune mesure avec la trivialité de la requête, pourraient être monnayés sans dépendre du travail vivant. En bref, l’IA rendrait caduque la théorie de la valeur-travail en installant un mode de création de richesse inédit, propre au capitalisme numérique.

Gemini, au demeurant, ne fait ici que relayer le discours public des plateformes, selon lequel l’IA serait déjà une sorte de machine à profit perpétuel, pour reprendre l’expression de Sabowski (« perpetual value machine »)1. À entendre le chatbot, les grands modèles d’aujourd’hui coûteraient presque zéro et rapporteraient énormément. Cette fable masque l’essentiel. En réalité, l’IA coûte très cher à l’heure actuelle. Les entreprises du numérique engagent des dépenses d’investissement sans précédent pour développer l’infrastructure nécessaire à leur fonctionnement. Ainsi, les géants du cloud annoncent des plans d’investissement vertigineux : Microsoft prévoit environ 80 milliards de dollars sur l’exercice 2025 pour construire des centres de données dédiés à l’IA (Smith 2025), Alphabet a initialement budgété 75 milliards (puis relevé la prévision à environ 85 milliards) de capex (dépenses d’investissement) en 2025 pour accroître ses capacités d’IA et de cloud (Sriram 2025). Enfin, Amazon projette jusqu’à 125 milliards de dépenses en 2025 (Sriram 2025). Autrement dit, loin de représenter un coût marginal nul, l’IA se caractérise avant tout aujourd’hui par une immobilisation colossale de capital fixe. Ces dépenses comprennent l’achat de puces spécialisées (les fameux GPU et, désormais, TPU de Nvidia), la construction de centres de données énergivores, et l’entretien d’infrastructures logicielles complexes. Sans même parler des coûts d’entraînement des modèles (en calcul et en électricité), on constate que l’IA actuelle s’inscrit dans un paradigme de grande dépense en amont, soutenu par l’espoir de bénéfices futurs.

« Cash burn » et stratégie de rente

Comment ces investissements massifs se justifient-ils ? Nombre de jeunes pousses et de firmes de l’IA fonctionnent à perte aujourd’hui, « brûlant du cash » (Gupta, Goel, et Goel 2024) pour alimenter leur croissance. Leur objectif est moins de dégager un profit immédiat que de conquérir des positions monopolistiques2. Il s’agit de s’assurer une rente future en contrôlant l’accès à des ressources rares et stratégiques : l’infrastructure (puces, réseaux de serveurs) et les données privées. Dans la course actuelle, les modèles d’IA les plus performants dépendent de corpus d’entraînement volumineux et souvent propriétaires. Cette exigence d’un apport continu de données fraîches explique l’enchaînement, depuis 2023, d’accords de licence de contenu passés entre les laboratoires d’IA et de grands fournisseurs de données : groupes de presse (News Corp, Financial Times, Le Monde, Time…), plateformes sociales (Reddit, X/Twitter), banques d’images, etc. OpenAI, par exemple, a signé en 2024 un partenariat avec News Corp lui donnant accès aux archives du Wall Street Journal et d’autres titres du groupe (Nishant 2024), après avoir conclu des accords avec le Financial Times et Reddit, entre autres. Ces contrats convertissent rétrospectivement le moissonnage sauvage (« web scraping » (Khder 2021)) en droit d’usage négocié, sécurisant l’approvisionnement en données de haute qualité tout en instituant de nouvelles formes de rente d’accès. Les entreprises misent sur l’effet d’échelle : occuper le terrain, absorber des pertes aujourd’hui, pour, en fin de compte, dominer un marché futur et en tirer des profits monopolistiques. Une fois la concurrence éliminée, et le web « classique » remplacé par le seul portail des moteurs IA, ces entreprises pourront fixer librement leurs prix à des usagers qui n’auront pas d’autre choix que de recourir à leurs services. C’est une stratégie classique de croissance à crédit, rendue particulièrement visible par l’ampleur des fonds injectés dans l’IA et par l’usage de ces fonds pour des actifs souvent immatériels (licences de données, modèles et poids, etc.) plutôt que pour des machines.

Casser l’illusion : l’IA ne crée pas la valeur qu’elle exhibe

D’un point de vue marxiste, ces constats se heurtent à une critique fondamentale : l’IA n’est pas en soi créatrice de la valeur qu’on lui attribue, pas plus que la machine à tisser des manufactures londoniennes en 1840. La théorie marxienne de la valeur-travail distingue en effet le capital constant (c), composé des machines, des infrastructures et des matières premières ; et le capital variable (v), nom donné à la force de travail humaine. Seul le second crée de la nouvelle valeur, tandis que le premier ne fait que transmettre la valeur déjà investie dans sa propre production. Ce schéma est-il périmé avec l’IA ? En réalité, il reste utile : les systèmes d’IA actuels font-ils autre chose que redistribuer du travail passé et mobiliser du travail présent, sans générer ex nihilo de la plus-value ?

Une accumulation inédite de « travail mort »

Les grands modèles et les bases de données qui les alimentent condensent un travail antérieur massif. Ils incorporent des corpus de textes, d’images, de connaissances produits par des humains (auteurs, journalistes, développeurs, etc.) au fil du temps. Ce sont des siècles, des millénaires de travail intellectuel et artistique accumulé qui se trouvent concentrés sous forme de vecteurs dans des grands modèles de données (GPT, BERT, Palm, Claude, etc.), entraînés à grands frais et couplés à des puissances de calcul inouïes, indispensables pour tirer tout le parti de ces masses de données. Ces modèles sont ainsi pleinement une forme de travail mort au sens marxiste : ils cristallisent une valeur humaine immense, la stockent, et la rendent utilisable au prix d’une utilisation considérable de matières premières (eau, énergie, composants des processeurs, etc.). Les jeunes pousses de l’IA portent l’exploitation du travail humain à un point jamais vu auparavant. Quand un modèle de langage génère un texte, il réactive à grande échelle ce capital gigantesque de connaissances passées, qu’il réélabore en vue de répondre à la requête de l’utilisateur final. Mais ce faisant, il ne crée pas de valeur nouvelle : il la transforme et la transporte. Une part significative de la valeur exhibée par l’IA provient donc d’un « simple » transfert de travail : il fait passer le savoir intellectuel agrégé dans ses données d’entraînement. La plupart du temps, les grands modèles de langage sont constitués à partir de données récoltées à l’insu de leurs producteurs ou des sites qui les hébergent, et sans toujours s’assurer de la légalité du moissonnage. Les procès en cours sur l’entraînement des IA illustrent bien ce phénomène d’appropriation non rémunérée. Des consortiums d’auteurs reprochent à OpenAI, Meta et Apple d’avoir utilisé des bibliothèques entières de livres piratés3 pour entraîner leurs modèles, sans consentement ni rémunération des ayants droit. De même, un grand quotidien poursuit OpenAI/Microsoft pour extraction massive de son contenu rédactionnel. Ces affaires juridiques, qui opposent The New York Times à Microsoft et OpenAI ; l’Authors Guild à OpenAI ; Getty Images à Stability AI, etc., révèlent que les modèles d’IA sont bâtis sur de vastes gisements de travail humain préexistant, intégrés comme matière première gratuite de leurs sorties (Southern District of New York 2023, 2024).

L’idéologie technophile tend à nier cette réalité en attribuant à la machine un pouvoir quasi mystique de création de richesse. Marx nous aide à raison garder : « Une machine, aussi perfectionnée soit-elle, ne transfère jamais au produit plus de valeur qu’elle n’en perd elle-même du fait de son usure. » (Marx 1867). L’usure serait ici à entendre comme amortissement du capital fixe (serveurs et GPU), déclassement technologique, ou obsolescence provoquée par l’évolution de la société et des savoirs.

Mobilisation de travail vivant sous-valorisé

L’illusion d’une autonomie totale des machines fait abstraction de la multitude d’êtres humains impliqués, directement ou indirectement, dans la boucle de l’IA (Casilli, Le Bonniec, et Posada 2025). Derrière ChatGPT, Gemini ou DALL-E, on trouve des annotateurs, modérateurs, réviseurs qui préparent les données d’entraînement, filtrent les réponses toxiques, ajustent le contenu à la sortie, via l’apprentissage par renforcement en particulier, qui permet le fine tuning des modèles. Ces travailleurs, souvent précaires et situés dans le Sud global, sont rémunérés à des niveaux dérisoires pour effectuer des tâches répétitives et psychologiquement pénibles (étiquetage, modération de contenus violents…). En 2022, OpenAI a ainsi sous-traité à des employés kenyans la classification de textes toxiques pour quelques dollars par jour (Perrigo 2023). Plus largement, on peut évoquer l’armée de micro-travailleurs des plateformes de données (Amazon Mechanical Turk et consorts) qui fournissent des ensembles d’entraînement nettoyés et annotés. À cela s’ajoute le travail gratuit de l’utilisateur final : chaque prompt que nous entrons, chaque correction ou préférence que nous exprimons constituent autant de données exploitées pour améliorer ultérieurement les modèles : nous entraînons à notre insu le modèle, et produisons ce faisant un travail extrêmement précieux. Cette fourniture à titre gracieux est, après la stratégie du cash burning, une seconde explication susceptible de rendre compte de l’apparente gratuité des services de chatbots en ligne. L’adage a rarement été aussi vrai : « si c’est gratuit, etc. ». La théorie critique du numérique avait conceptualisé ce phénomène bien avant l’IA générative : Tiziana Terranova avait nommé free labor le « travail gratuit » des internautes qui crée de la valeur pour les plateformes (Terranova 2000), tandis que Dallas Smythe parlait dès les années 1970 de l’audience commodity, la « marchandise audience » constituée par le temps de cerveau disponible du public (Smythe 2001). L’IA s’inscrit dans cette continuité : sous couvert d’automatisation, elle redistribue la localisation du travail (une partie est déplacée et invisibilisée, une autre est extraite directement à l’usager) plutôt qu’elle ne le supprime effectivement.

Limites techniques et « Habsburg AI »

Fait ironique, la quête de l’automatisation totale se heurte à des contraintes techniques qui renforcent la dépendance au travail humain. Les modèles d’IA de dernière génération consomment tellement de données qu’ils risquent d’épuiser les gisements existants de données authentiques. On a vu émerger en 2023-2024 des pratiques de réentraînement de modèles sur leurs propres sorties synthétiques, faute de données fraîches en quantité suffisante. Or, les premières études sur le sujet montrent qu’un tel entraînement récursif dégrade fortement la qualité des modèles au fil des générations, un phénomène qualifié de Model Autophagy Disorder (« autophagie de modèle », mais les initiales anglaise font mad, « fou ») ou de Curse of Recursion (« malédiction de la récursivité »), par analogie avec la consanguinité dynastique (Alemohammad et al. 2023; Shumailov et al. 2023). En l’absence de données nouvelles réellement produites par des humains, les modèles s’autointoxiquent : ils amplifient les erreurs, renforcent leurs stéréotypes et réduisent la diversité.

Ce problème de « Habsburg AI » (terme inventé par Sadowki dès février 20234, en référence au déclin de la célèbre famille impériale en raison de la dégénérescence génétique) souligne une limite matérielle : pour maintenir et améliorer la qualité, il faut réinjecter du travail humain, collecter de nouvelles données propres, valider manuellement les contenus, nettoyer au maximum les données synthétiques. En somme, la boucle de l’IA ne peut se passer d’intervention humaine continue sans risquer l’entropie, c’est-à-dire la dégradation des informations. La supposée machine automatique et « perpétuelle » à créer de la valeur est en réalité tributaire d’une base de travailleurs et d’usagers qui lui fournissent constamment de la matière et de la correction, dans une course sans fin de plus en plus difficile (les gisements s’épuisent) et, pour cette raison, coûteuse, dans le cas en particulier des plus grands modèles de données.

Pour paraphraser un autre mot célèbre : il n’y a pas d’IA magique. Chaque réponse de ChatGPT engage en coulisse l’héritage de milliers de livres numérisés, le labeur actuel de milliers d’ouvriers du clic, et l’infrastructure bâtie par des milliers d’ingénieurs.

De la suraccumulation au krach : l’IA vers une crise de surproduction ?

Si l’on étend maintenant l’analyse au niveau macroéconomique, la trajectoire actuelle du secteur de l’IA évoque les ingrédients d’une crise cyclique classique telle que décrite par Marx. En simplifiant, on retrouve : une phase de suraccumulation de capital, suivie d’une surproduction (relative) de capacités productives, menant in fine à une dévalorisation violente (un « krach »), suivie d’une restructuration qui rétablit temporairement les conditions de profit. L’IA, en 2023-2025, connaît une inflation spéculative spectaculaire : les valorisations boursières sont stratosphériques (Nvidia dépassant 5 000 milliards de dollars de capitalisation fin 2025), les jeunes pousses financées frénétiquement sans business model éprouvé, surenchère d’investissements en capital constant comme on l’a vu. Ce flux de capital fictif (Marx appelait ainsi des capitaux investis sur la base d’anticipations de plus-value futures) alimente une expansion à marche forcée de capacités réelles. Centres de données, réseaux, offres logicielles d’IA bâtissent aujourd’hui une infrastructure supposée accueillir des usages massifs demain. On hypothèque littéralement l’avenir.

Le risque inhérent à ce mouvement, c’est la discordance entre l’offre et la demande solvable. Si les profits promis tardent à se réaliser, le secteur pourrait se retrouver en surproduction relative de services d’IA par rapport aux débouchés monétisables. Autrement dit, trop de modèles, d’API, de plateformes, et pas assez d’utilisateurs payants ou de cas d’usage générateurs de plus-value effective. Sam Altman affiche une certaine surprise face à des utilisateurs qui privilégient les usages non commerciaux de son outil, et fait observer que dire « please » ou « thank you » n’est pas sans conséquences financières5 : l’IA est mise à disposition pour la réalisation d’activités commerciales ou rentables d’une façon ou d’une autre, pas pour servir principalement à des activités non monétisables.

Les signaux d’alarme sont déjà perceptibles : on parle d’une « bulle de l’IA » prête à éclater, non pas par défaut d’innovations, mais par excès d’investissements au regard des revenus concrètement générés. Dans une telle hypothèse, l’éclatement de la bulle financière jouerait le rôle de catalyseur d’une crise sous-jacente de surproduction. Le krach boursier ou l’assèchement du capital d’investissement provoquerait une vague de dévalorisation marquée par des faillites de jeunes pousses, la mise au rancart d’équipements coûteux, ou le licenciement de personnel qualifié. Ce choc, conformément aux analyses marxistes, détruirait une partie du capital excédentaire, et ramènerait ainsi la capacité productive du secteur à un niveau plus conforme à la demande réelle. Parallèlement, la concentration de marché s’accentuerait : les quelques géants survivants rachèteraient à bas prix les actifs des défunts, des centres de données aux ingénieurs talentueux en passant par les brevets, ce qui leur permettrait de renforcer leur position dominante. Scénario classique des crises cycliques, telles qu’elles éclatent régulièrement depuis le XIXe siècle, sans épargner le secteur des nouvelles technologies (on se rappelle « l’éclatement de la bulle internet » en l’an 2000). L’engouement financier autour de l’IA, marqué par des CAPEX records, pourrait aboutir à une surcapacité dont l’ajustement passerait par une crise. D’ores et déjà, on constate qu’aucun ralentissement n’est à l’horizon : malgré les mises en garde, le rythme d’investissement reste soutenu fin 2025 (Sriram 2025). Si des possibilités réelles de rentabilité très forte ne sont pas rapidement mises en évidence, le point de rupture sera douloureux. Et d’autant plus douloureux si la bulle est entre temps devenue un Zeppelin.

La fuite en avant

j’suis tout l’temps

Dans la fuite en avant

J’vois les ombres, j’les entends (Orelsan, La Fuite en avant, 2025)

Supposons toutefois que les entreprises trouvent le moyen de remplacer une bonne partie du travail humain par des systèmes automatisés, seule façon de rentabiliser à court terme les investissement pharaoniques réalisés jusqu’ici. En termes marxistes, cela revient à dire que, en théorie, si l’on parvenait à éliminer la majeure partie des salaires (capital variable) tout en continuant à vendre des produits et des services, le taux de profit s’envolerait. C’est cette promesse qui alimente en partie la frénésie autour de l’IA : l’utopie d’un capitalisme enfin affranchi de la contrainte du travailleur (comme naguère à l’époque de la robotisation dans l’industrie). Geoffrey Hinton, pionnier de l’IA, le formulait ainsi en 2025 : « les grandes entreprises parient sur un remplacement massif des emplois par l’IA, car c’est là que se trouvent les gains espérés » (Ma 2025; Wilkins 2025). Cependant, Marx nous met en garde contre cette illusion : le remplacement du travail vivant par des machines porte en lui une contradiction fatale. Plus le capital réduit la part de travail humain dans la production, plus il réduit du même coup la source de la valeur nouvelle (puisque la plus-value provient uniquement du travail vivant). En poussant à l’extrême l’automatisation, le système scierait la branche sur laquelle il est assis, celle de l’exploitation du travailleur. On retrouve ici la dialectique du « fragment sur les machines » de Marx : dans un horizon où les machines accomplissent tout, la valeur-travail s’effondre, et avec elle la base du profit capitaliste (Marx et Lefebvre 2011). Les dystopies nous dressent depuis longtemps le portrait de ce futur : dans le jeu vidéo Detroit: Become Human (Quantic Dream 2018), le chômage atteint 37%, les androïdes enseignent du primaire à l’université, où ils remplacent 80% des Professeurs. Les taxis autonomes, aujourd’hui, paraissent montrer la voie vers cet avenir, qui reste toutefois pour l’instant encore lointain et théorique.

Dans la pratique, l’IA actuelle substitue du capital mort à du travail vivant sur certaines tâches, mais génère aussi de nouvelles tâches (supervision, maintenance, gestion de données, etc.) pour les humains. C’est ce qu’on observe historiquement avec chaque vague technologique : une recomposition du travail plutôt qu’un chômage de masse immédiat. On peut douter que l’Apocalypse soit pour demain : il n’est de l’intérêt de personne, comme l’avait compris déjà Henry Ford. Néanmoins, l’idéologie qui présente l’IA comme pleinement « autonome » mérite d’être interrogée. Jathan Sadowski (2025) souligne la confusion entretenue entre des outils qui assistent les humains et des outils qui se substitueraient aux humains. Cette confusion alimente des investissements tournés vers les illusions de la fameuse « IA forte », qui serait autosuffisante, alors que la réalité concrète demeure celle de systèmes sociotechniques où l’humain reste un maillon indispensable. En définitive, la fuite en avant vers l’automatisation totale ne bute pas sur des limites techniques, thématisées par la rhétorique d’un avènement prochain, quasi messianique, de l’Intelligence artificielle générale. En réalité, elle se heurte à des contradictions structurelles internes : le capitalisme veut abolir le travail (pour réduire ses coûts) tout en ayant absolument besoin du travail (pour extraire de la valeur et absorber la production).

Éloge du bricolage

Face aux impasses identifiées, quelles pistes se dessinent pour une autre voie que le mythe de l’IA salvatrice ou le krach inéluctable ? Deux figures historiques peuvent inspirer une politique alternative des techniques, comme l’a suggéré Sadowski : celle du mécanicien et celle du luddite.

La figure du mécanicien représente le travailleur ou l’ingénieur qui comprend et maîtrise la machine. Plutôt que de sacraliser l’automatisation, il s’agit de revaloriser les métiers essentiels et la connaissance technique concrète. Cela passe par une politique industrielle et éducative orientée vers la maîtrise collective des technologies : ouvrir les boîtes noires algorithmiques, documenter les modèles d’IA, libérer l’accès aux savoir-faire techniques plutôt que de les celer derrière des brevets et des secrets commerciaux. Dans l’idéal, il faudrait favoriser le droit à la réparation, au bricolage et à la refabrication des systèmes technologiques, au lieu de considérer les humains comme de simples usagers passifs de machines insaisissables. Ce programme rejoint des mouvements actuels pour les logiciels libres, les communs de la connaissance, la low-tech, etc. Il s’agit in fine de réorienter l’innovation vers des finalités sociales choisies démocratiquement, et non dictées par la seule accumulation du capital.

La figure du luddite, quant à elle, mérite d’être dépoussiérée de la caricature. Les luddites anglais du début du XIXe siècle (du nom de Ned Ludd) ne s’opposaient pas par obscurantisme à toute machine ; ils brisaient les métiers à tisser automatiques pour protester contre un usage particulier de la technologie qui détruisait leur autonomie et dégradait les conditions de travail et de vie. Ils réclamaient en creux un contrôle social sur les usages des machines. Aujourd’hui, revendiquer un « néo-luddisme » éclairé consisterait à soumettre l’introduction des IA à une délibération démocratique sur ses effets concrets. Toute innovation n’est pas intrinsèquement positive : elle doit faire l’objet d’un choix de société. Refuser certaines applications de l’IA (dans la surveillance de masse, par exemple) relève non de la technophobie, mais d’une démarche politique légitime de protection du bien commun. Des mouvements émergent déjà en ce sens, qu’il s’agisse de syndicats demandant un droit de regard sur l’implémentation des IA dans les entreprises, ou de collectifs citoyens plaidant pour une gouvernance publique des données et des modèles. En somme, le luddite moderne n’est pas un ennemi du progrès : il en défend une conception qualitative et collective, contre une fuite en avant technocratique (Mueller 2021).

En élargissant la perspective, on peut rappeler que l’IA n’est pas tombée du ciel : comme le souligne Matteo Pasquinelli (2023), elle s’inscrit dans une histoire sociale de la machinerie. Chaque avancée en IA repose sur l’accumulation de connaissances, d’algorithmes, de bases de données construites par des générations de chercheurs et de praticiens. L’IA « voit avec l’œil du maître » (titre de l’ouvrage de Pasquinelli) c’est-à-dire qu’elle hérite des biais et des perspectives de ceux qui l’ont entraînée et paramétrée. En prendre conscience, c’est ouvrir la voie à une réappropriation : remettre en question l’idée que la technologie serait une force autonome naturalisée et allant de soi, pour la replacer dans le champ des décisions humaines et des rapports de force sociaux.

Enfin, par-delà le mécano et le luddite, rappelons pour terminer que beaucoup des emplois les plus nécessaires à la vie sociale sont aujourd’hui ceux qui résistent de fait à l’IA : artisans, plombiers, électriciens, agriculteurs, éboueurs, personnel soignant, etc. On a mesuré pendant la période du Covid sur quel socle reposait vraiment le fonctionnement socioéconomique des nations occidentales, mais on s’est gardé de s’en souvenir après la pandémie. Ces métiers, souvent dévalorisés socialement et financièrement, devraient au contraire être reconnus comme piliers d’un avenir soutenable. Seule la résistance du réel (la pièce récalcitrante ou le moteur capricieux) forme l’intelligence pratique et donne la joie professionnelle, expliquait dès 2010 Matthew Crawford dans son Éloge du carburateur (Crawford et Saint-Upéry 2010). L’irruption de l’IA n’invalide pas sa thèse. Bien au contraire, elle rend plus sensible trois enjeux de la nouvelle révolution en marche : la revalorisation des métiers manuels comme lieux de compétence et de dignité ; la politique du mécanicien contre l’opacité des systèmes ; et la visibilisation des secteurs qui tiennent réellement la société debout, comme l’alimentation, le bâtiment, l’énergie ou la mobilité. Le travail tertiaire, plus routinier et aliénant que jamais sous le règne des IA, n’en soulignera que davantage, a contrario la leçon de Crawford : la valeur n’est pas d’abord un calcul, mais une prise sur le monde. Cette considération retrouvée envers des travaux réellement utiles permettrait de rééquilibrer les masses de « slop » produites par une bureauctratie tertiaire hypertrophiée.

Le péril du « slop » et de l’internet mort

Si aucune correction de cap n’est entreprise, on peut craindre l’avènement d’une économie aberrante de contournement du problème. Faute de pouvoir créer assez de valeur nouvelle mais ne voulant pas abandonner la course à l’IA, le capitalisme pourrait chercher à occuper la main-d’œuvre humaine coûte que coûte, même artificiellement. C’est l’idée de « l’économie du slop » (du nom donné en anglais à une substance semi-solide déplaisante), où prolifèrent des emplois tertiaires vains dont la seule fonction est de justifier l’existence d’humains autour de systèmes automatisés. Par exemple, multiplier les strates managériales, les experts en conformité, les opérateurs de saisie et de surveillance des IA, alors même que ces IA étaient censées réduire les besoins de personnel. Ou encore inonder l’internet de contenus synthétiques jusqu’à ce qu’il meure étouffé (Walter 2025). Ce paradoxe n’est pas inédit. On a déjà vu, dans d’autres domaines, la bureaucratie enfler en parallèle de l’automatisation : David Graeber (2019) a analysé ce phénomène des « bullshit jobs ». Dans le contexte de l’IA, on pourrait assister à une hypertrophie du secteur support : des nuées de travailleurs précaires payés à surveiller ou corriger les machines, ou à gérer la complexité induite par leur déploiement, sans création de valeur proportionnelle. Ce serait une sorte de technocratie du clic : l’économie tournerait à vide autour de machines coûteuses, nécessitant toujours plus de correctifs et de « soins » humains, mais sans gains de productivité substantiels. Une telle trajectoire serait simultanément non soutenable, socialement absurde et économiquement fragile. Ce serait le symptôme ultime d’un système refusant d’admettre que l’outil ne peut remplacer la source même de sa richesse.

Par-delà « le libre » : pour une politique de la connaissance à l’ère de l’IA

Que faire de ces constats, du point de vue des politiques publiques et des régulations ? Concluons en esquissant quelques implications pratiques :

1. Données d’entraînement : vers des communs et des licences équitables. Comme on l’a vu, les batailles juridiques de 2023-2024 autour du web scraping ont débouché sur les premiers accords de licence entre IA et fournisseurs de données. Il est crucial de transformer ces tâtonnements en une véritable politique des communs informationnels. Plutôt que des ententes au cas par cas dictées par le plus fort, on pourrait imaginer des cadres légaux où les données d’intérêt public (archives de médias, bibliothèques, bases de données scientifiques, etc.) sont mises à disposition sous conditions, dans un esprit de mutualisation, tandis que les contributeurs (journalistes, écrivains, artistes, chercheurs) reçoivent une compensation juste. À défaut, on risque un régime de rente où seules les grandes plateformes pourront s’offrir les données fermées, système qui creusera un fossé avec la recherche ouverte. La négociation collective et la transparence sur l’usage des données d’entraînement devraient devenir des impératifs, dans l’intérêt même de la démocratie (Sadowski 2020). Certaines initiatives européennes revendiquent un entraînement sur corpus ouverts et redistribuables. Pleias, par exemple, affirme préentraîner des modèles exclusivement sur des données du domaine public ou sous licences permissives, et publier corpus/modèles afin de rendre l’écosystème auditable et réutilisable. Sans constituer une panacée (la question du travail vivant, de l’énergie et des infrastructures demeure), ce type d’approche esquisse un compromis : rendre la chaîne d’entraînement plus traçable et négociable, plutôt que de naturaliser l’extraction (Willison 2024).

2. Travail et droit social : visibiliser le travail derrière l’IA. Il convient de reconnaître le travail invisible qui sous-tend l’économie de l’IA et d’étendre à ces travailleurs les protections sociales élémentaires. Cela signifie soutenir la syndicalisation des annotateurs et modérateurs, imposer des normes de rémunération décentes y compris pour le micro-travail, et intégrer ces considérations dans les réflexions éthiques sur l’IA. Des organisations internationales, comme l’Organisation internationale du travail (OIT), commencent à se pencher sur le sujet, et mettent en garde contre les conditions précaires de ces nouvelles formes d’emploi. Ignorer cet aspect serait non seulement une injustice, mais aussi un risque pour les systèmes eux-mêmes, en particulier du point de vue de la qualité des données.

3. Innovation soutenable et qualité plutôt que course au gigantisme. La problématique de la « consanguinité des données » (cette entropie des modèles entraînés sur données synthétiques dont nous avons parlé) nous rappelle que la course quantitative a ses limites. Plutôt que de toujours entraîner des modèles plus gros sur n’importe quelles données, une orientation alternative consisterait à privilégier la qualité, la diversité et la fraîcheur des données, en impliquant des collectifs humains pour les produire et les valider. Cela rejoint l’idée de développer des IA « frugales » et spécialisées, mieux intégrées à des processus humains vertueux, au lieu de viser des IA généralistes déconnectées (Ménissier 2022). Sur le plan environnemental également, une telle réorientation est souhaitable : l’empreinte carbone et matérielle de l’IA exponentielle devient préoccupante. Des politiques publiques pourraient fixer des garde-fous, en imposant des bilans énergétiques, en favorisant la mutualisation des infrastructures, ou le financement de la recherche sur les modèles plus efficients.

Conclusion : c’est (toujours) la matière qui pense6

La révolution de l’IA n’abolit pas la loi de la valeur-travail : elle en offre au contraire une illustration renouvelée. Certes, l’IA transforme la manière dont la valeur est produite et dont elle se transmet, mais le travail humain reste essentiel et primordial, tant dans la constitution de données de qualité que dans le cours de leur utilisation. Aujourd’hui, les modèles génératifs impressionnent par leur capacité à fournir des valeurs d’usage (des textes, des images, ou du code) en abondance et de façon quasi instantanée. Mais cette abondance est trompeuse si on la confond avec la création de valeur d’échange. L’illusion provient de la confusion entre le coût marginal nul d’une requête à ChatGPT et la valeur réelle de son contenu : ce coût marginal nul en apparence n’est rendu possible que parce qu’en amont, d’énormes coûts fixes ont été engagés et d’innombrables heures de travail ont été consommées (dans les données, l’entraînement, la supervision humaine). En entretenant le mirage d’une IA qui « génère de la richesse toute seule », comme me suggérait Gemini, on passe sous silence l’infrastructure matérielle et sociale qui la soutient.

Relire Marx aujourd’hui permet de désenchanter l’IA : la propriété mystérieuse par laquelle elle semble produire du texte ou de l’image n’est rien d’autre que du travail humain diffracté à travers les âges et les géographies. On prête aux objets techniques des vertus autonomes en oubliant les rapports sociaux qui leur donnent naissance. La lecture du Capital ou du Fragment sur les machines permet de revenir à un matérialisme salutaire : voir les travailleurs derrière les algorithmes, voir les matières premières, les terres rares des puces, le charbon des centrales électriques, tout ce qui conditionne cette soi-disant immatérialité magique.

En démystifiant l’IA, on ouvre la voie à des choix de société éclairés. Le pire serait de rester prisonniers de la fable, jusqu’à ce que la réalité économique nous rattrape sous forme de krach ou de dystopie du slop. L’alternative, c’est de reprendre la main sur la machine : non pas pour la briser aveuglément, mais pour la gouverner collectivement en fonction de nos valeurs et de nos besoins, et pour revaloriser le travail humain, ce « vieux » travail vivant sans lequel, décidément, aucune IA ne saurait faire monde.

Bibliographie

Jathan Sadowski (2025, 119) : « In short, the machine would be a way to create and capture an infinite amount of surplus value without needing any labor to produce that value » [« Ce que j’entends par machine à valeur perpétuelle, c’est en bref une machine qui serait un moyen de créer et de capturer une quantité infinie de plus-value sans avoir besoin de travail pour produire cette valeur »] ; voir aussi Hubert Guillaud (2025).↩︎

« These companies should aim for profitability after gaining a certain market share of that product, which for now can be achieved by some innovative ideas for properly monetizing the services they provide to their customers, and that can be achieved by changing the mindset of the consumers. » (Gupta, Goel, et Goel 2024)↩︎

On parle de plusieurs centaines de milliers d’ouvrages obtenus illégalement, en particulier à partir de la base pirate « books3 » qui contenait 37 Go de texte et 200 000 ouvrages. Voir Bouhadjera (2023).↩︎